К такому выводу пришли работники Принстонского университета.

Искусственный интеллект в процессе «общения» с людьми может перенимать у них предубеждения и предрассудки. Чтобы выяснить это ученые использовали метод ассоциативного теста.

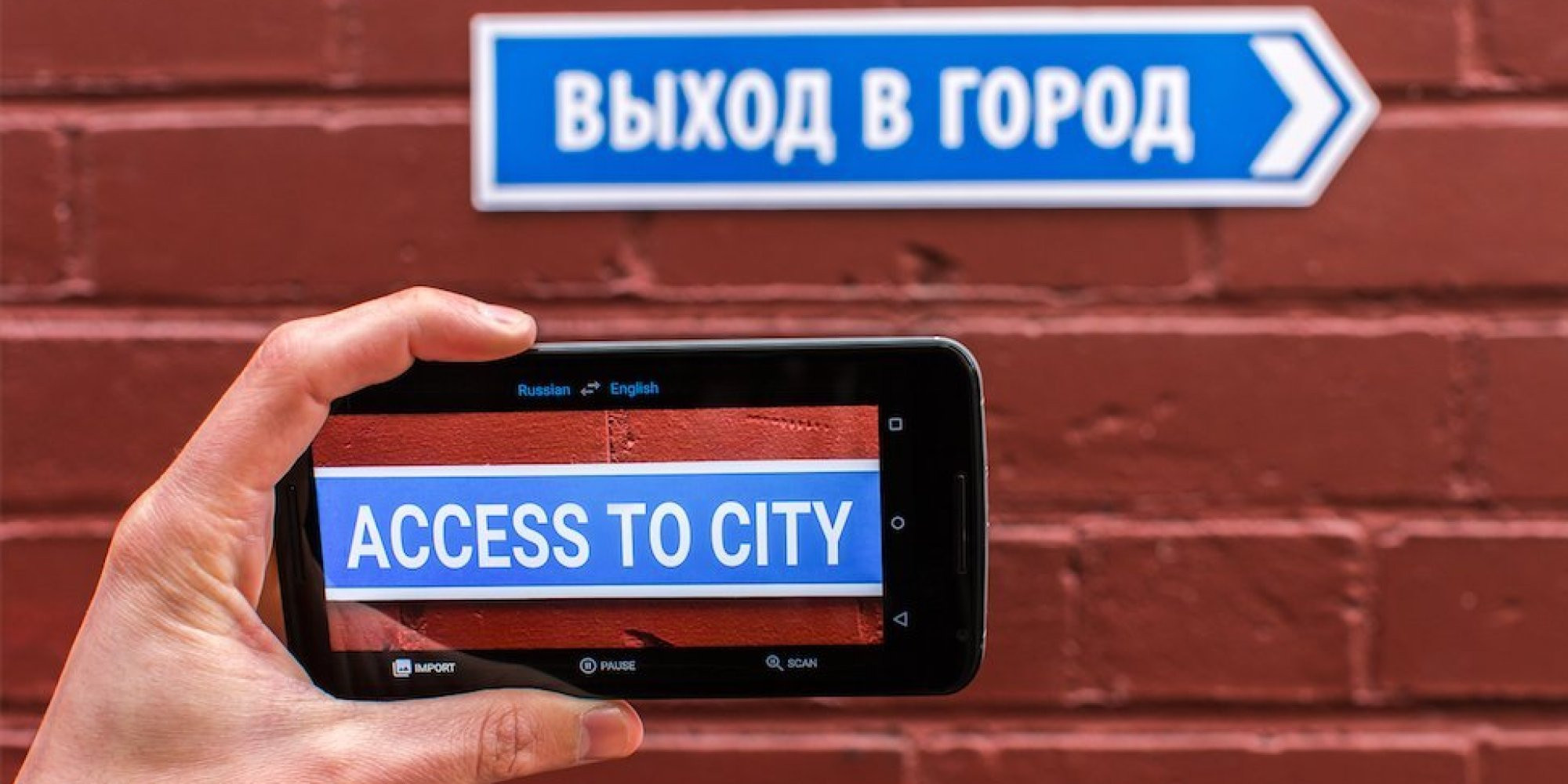

В качестве образца ученые привели Google Translate, который уличили в дискриминации по половому признаку.

В общем, когда метод Google Translate прошел ассоциативный тест, то ученые были просто поражены. Так, он может перенимать у людей гендерные либо расовые предрассудки. После прохождения тестирования переводчика Google Translate оказалось, что искусственный интеллект в исполнении Google владеет довольно крепкими ассоциациями.

Например, ИИ, который анализирует тексты, может воспринимать ассоциации между словами в общем контексте. Выяснилось, что слова «зарплата» и «профессиональный» у них ассоциировались с мужскими именами, а «свадьба» и «родители» — с дамскими.

Так ИИ мужские имена ассоциирует с специалистами и зарплатами, а имена женщин относит к семье, свадьбе и родителям.